智能识别技术选型

我们在完成智能识别任务的时候通常会站在巨人的肩膀上完成我们自己的智能识别业务开发,有关智能识别的Java技术框架有很多,在做选择的时候总是被五花八门的技术框架所困扰,选择哪个技术框架可以完成自己的目标任务呢?本文详细介绍DL4J和DJL的区别以及针对这两个框架怎么做选择。

Deeplearning4j (DL4J) 和 Deep Java Library (DJL) 都是 Java 生态系统中用于深度学习的库,但它们的设计理念、架构定位和使用场景有显著区别。

核心架构与设计理念

Deeplearning4j (DL4J)

定位:一个原生的、独立的深度学习框架,专为 JVM(Java 虚拟机)设计。

后端:拥有自己的底层数值计算库 ND4J(类似于 Python 中的 NumPy),支持 CPU 和 GPU 加速。

生态:提供了一整套工具链,包括数据预处理(DataVec)、强化学习(RL4J)等。

特点:旨在让 Java 开发者在不依赖 Python 环境的情况下,从头开始构建和训练深度学习模型。

Deep Java Library (DJL)

定位:一个引擎无关的抽象层(Abstract Layer),由 AWS 开源。

后端:本身不包含底层计算引擎,而是作为统一接口调用现有的引擎(如 PyTorch、TensorFlow、MXNet、ONNX Runtime 等)。

生态:专注于模型推理(Inference)和训练的统一 API,强调与 Python 训练模型的互操作性。

特点:旨在让 Java 开发者能够直接使用 Python 生态中训练好的模型,无需转换模型格式或重写逻辑。

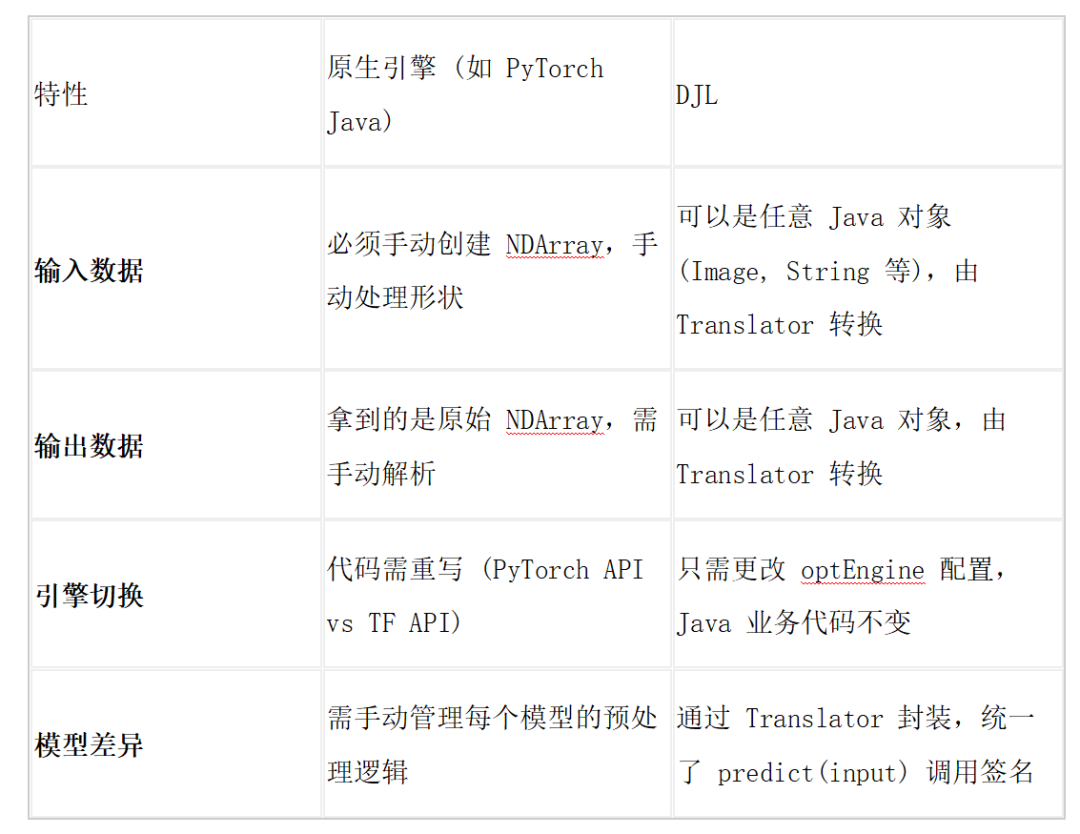

详细对比表

其他框架

在Java生态中除了DJL之外还有一些类似的库来解决和DJL类似的问题(在 Java 中运行机器学习/深度学习模型),它们的侧重点有所不同,有的侧重于标准格式,有的侧重于特定框架,有的侧重于服务化。下面一并介绍。

ONNX Runtime (Java API)

ONNX (Open Neural Network Exchange) 是一种开放的模型格式标准。ONNX Runtime 是微软开源的高性能推理引擎,支持 Java 绑定。

与 DJL 的区别:

模型格式:DJL 可以直接加载 PyTorch 或 TensorFlow 的原始模型格式;ONNX Runtime 必须先将模型转换为 .onnx 格式。

引擎:DJL 动态切换底层引擎(PyTorch/TensorFlow 等);ONNX Runtime 使用统一的 ONNX 执行引擎。

优势:跨语言、跨框架的标准性更好,推理性能通常经过高度优化。

TensorFlow Java (官方绑定)

TensorFlow 官方提供的 Java API。允许用户在 Java 中构建、训练和推理 TensorFlow 模型。在API文档中已标明处于废弃状态。

与 DJL 的区别:

兼容性:仅支持 TensorFlow 模型,不支持 PyTorch 等其他框架。

版本同步:有时 Java API 的功能更新滞后于 Python 核心库。

优势:官方支持意味着更好的兼容性和稳定性。

Konduit Serving

由 Deeplearning4j 的原班团队(Skymind/Eclipse)开发。它专注于模型部署和服务化,支持构建数据处理和模型推理的流水线(Pipeline)。

与 DJL 的区别:

定位:DJL 是一个库(Library),嵌入在应用中;Konduit 更倾向于一个服务框架(Server),虽然也有客户端库。

生态:深度集成 DL4J 和 ND4J,但也支持导入 ONNX 和 Keras 模型。

优势:适合需要复杂数据预处理流水线(ETL + AI)的场景。

Spring AI

Spring 官方推出的 AI 项目,旨在将 AI 模型集成到 Spring 应用中。

与 DJL 的区别:

抽象层级:Spring AI 更侧重于应用层集成(如 ChatClient、Prompt 管理),底层可能依赖 DJL 或其他客户端。

场景:更适合构建生成式 AI 应用(LLM),而 DJL 更通用(CV, NLP, Tabular 等)。

综合对比表

选型建议

选择 Deeplearning4j 的情况:

你需要一个纯 Java 的解决方案,且服务器环境无法安装 Python 或相关原生依赖(如 CUDA 库以外的 Python 环境)。

你希望在 JVM 内部完成从数据预处理到模型训练的全过程,且不依赖外部框架。

项目是遗留系统,已经深度集成了 DL4J 生态。

选择 DJL 的情况:

你的模型主要由数据科学家使用 Python (PyTorch/TensorFlow) 训练,你需要将其部署到 Java 后端。

你希望利用特定引擎的最新特性(例如 PyTorch 的新算子),而不想等待 Java 库的更新。

你需要灵活切换底层引擎(例如从 MXNet 切换到 PyTorch)而不想重写大量 Java 业务代码。

DJL工作介绍

首先需要明确的是djl并不具备魔法让所有模型接收相同的输入或者产生相同的输出。图像模型需要像素矩阵,文本模型需要 Token ID,表格模型需要数值向量。

DJL 屏蔽差异的核心机制并不是强行统一输入输出格式,而是通过 Translator(转换器)接口 将“数据预处理”和“结果后处理”逻辑封装起来,从而统一了调用方式。DJL抽象的是如何调用引擎,而数据如何适配模型的逻辑是通过Translator由基于DJL开发的人员或者DJL框架的开发人员预定义来实现。

核心机制:Translator 接口

在 DJL 中,Predictor 是进行推理的对象,而 Translator 是 Predictor 的大脑,负责处理数据流转。它的工作流程如下:

Preprocess(预处理):将 Java 对象(如 BufferedImage, String, float[])转换为模型需要的 NDArray(张量)。

Process(推理):调用底层引擎(PyTorch/TensorFlow 等)进行计算。

Postprocess(后处理):将模型输出的 NDArray 转换为 Java 对象(如 Classifications, DetectedObjects, String)。

通过这种方式,无论底层是 PyTorch 还是 TensorFlow,上层 Java 代码看到的始终是 InputObject -> ResultObject 的过程。

DJL 到底屏蔽了什么?

所以,总的来说:DJL 也同样做不到消除模型之间输入输出的逻辑差异(图像依然需要 resize,文本依然需要 tokenization),但它通过 Translator 模式 将这些差异封装在了模型加载阶段。

对于使用者:调用接口统一为 predictor.predict(input)。

对于开发者:通过实现 Translator 来适配特定模型的数据要求。

这种设计使得业务代码与具体的数据处理逻辑解耦,同时也实现了与底层深度学习引擎的解耦。

总结

简单来说,Deeplearning4j 是 Java 界的 TensorFlow(试图构建独立的 JVM 深度学习生态),而 DJL 是 Java 界的 JDBC(为不同的深度学习引擎提供统一的访问接口)。目前业界趋势更倾向于使用 Python 训练、Java 推理,因此 DJL 在新项目中的适用性通常更高。

地址

地址 电话

电话 邮箱

邮箱